ROMA – In caso di inevitabile incidente d’auto, uccideresti pedoni o passeggeri?

Qualcuno questa domanda se l’è posta.

Le auto a guida autonoma stanno diventando una realtà sempre più consolidata, e non è escluso che in un futuro diremo addio a volante e pedali.

Ma adesso la questione è seria.

Queste vetture andranno programmate. Anche in caso d’incidente.

Chi uccideresti tra pedoni e passeggeri?

Chi uccideresti tra pedoni e passeggeri?

Alcuni ricercatori hanno sollevato lo scomodo dilemma.

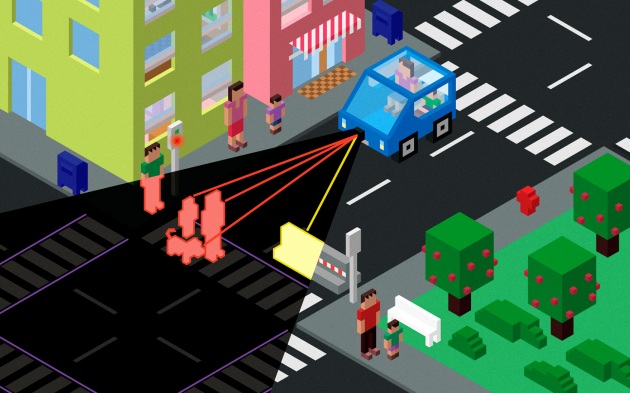

Se un veicolo in caso d’incidente ha da scegliere tra solo due alternative, investire due pedoni o sbattere contro un muro, qual è la decisione migliore?

E’ uno scenario inquietante.

I ricercatori Iyad Rahwan, del MIT di Boston, Jean-Francois Bonnefon delll’università di Tolosa, e Azim Shariff, dell’università dell’Oregon, hanno condotto uno studio per vedere la risposta umana al dilemma.

Tra giugno e novembre 2015 hanno coinvolto circa 200 cittadini degli USA chiedendo come si sarebbero comportati davanti a scelte del genere.

La risposta umana

La maggior parte dei partecipanti ha dato la risposta più “umana”: prendere la decisione in base al numero delle vite.

In sostanze, cercare di salvare più persone.

E se invece a bordo ci fossi te o la tua famiglia? Comprersti l’auto? Ti sacrificheresti per salvare i pedoni?

A qeusta domanda lo scenario è chiaro: la maggior parte degli intervistati non acquisterebbe l’auto o non ci salirebbe proprio.

Ma il “codice killer” andrà programmato.

A chi spetta dunque, scegliere la “programmazione della morte”?

“Si tratta di una sfida formidabile per definire gli algoritmi che guideranno gli AV (veicoli autonomi) di fronte a questi dilemmi morali”, spiegano i ricercatori. “Noi sosteniamo che per raggiungere questi obiettivi, i produttori e le autorità dovranno fare approfonditi studi psicologici per una soluzione etica in incidenti che coinvolgono AV”.

Compreresti un’auto programmata per ucciderti?

Il mercato della auto a guida autonoma rischia di incontrare questioni etiche, piuttosto che tecniche.

Ma, “se poche persone acquistano automobili senza pilota perché programmate per sacrificare i loro proprietari” sostiene il MIT “poi sempre più persone rischieranno di morire perché le auto normali hanno molti più incidenti di quelle a guida autonoma”.

Primo incidente mortale causato dal pilota automatico

Un inganno cromatico è stato la causa della collisione tra una Tesla Model S e un tir, provocando la morte di un uomo. Si tratta del primo incidente mortale causato da un’auto a guida autonoma.

Joshua D. Brown di Canton, Ohio ha perso la vita il 7 maggio a Williston, Florida, quando le telecamere della sua Tesla non sono riuscite a distinguere il colore bianco di un tir.

Non riconoscendo l’ostacolo, il pilota automatico non ha attivato i freni.